Un uso práctico de los sistemas de IA generativa es la de generar textos. La gran competencia -no inteligencia- que muestran estos sistemas los hace muy útiles a la hora de generar cualquier tipo de texto; desde rutinarios boletines de correo comercial, memorias de empresa y resúmenes financieros hasta creativos poemas que nos dejan boquiabiertos. ¿Podemos confiar en ellos?

He elegido el término boquiabiertos con toda intención: el efecto de incredulidad que nos provocan sus capacidades hace que atribuyamos a estos sistemas una inteligencia que no tienen. Y este es el riesgo. Si los consideramos inteligentes nos costará mucho poner en cuestión un texto que tiene un nivel de redacción, de datos y de fuentes muy superior a la media.

En general nos cuesta mucho cuestionar las decisiones de cualquier máquina. ¿Cuántas veces no hemos oído aquello de que «no me sale, es que soy negado/a para estas cosas»? Este punto débil nuestro es en realidad su punto fuerte. Si lo llevamos al terreno de la experiencia de una web, una aplicación o un cajero automático que nos hace la vida imposible -Generalitat, RENFE, parquímetro- el problema no es nuestro, es de ellos: ¡quien «no se ha salido porque es negado/a para estas cosas» es quien lo ha diseñado!

Si ya mostramos esta sumisión ante una máquina sin ningún tipo de inteligencia ¡imaginad ante un ChatGPT a quien creemos inteligente y omnisciente! Es por eso que cuando nos enfrentamos con uno de estos sistemas debemos tener el espíritu crítico más preparado que nunca. Son conocidas las «alucinaciones» (sí, este es el término técnico) que tiene el ChatGPT; cuando no sabe algo se lo inventa.

Su tono de seguridad, la verosimilitud del texto y el hecho de que nos lo diga una máquina nos hará muy difícil detectarlo.

Pero nos puede ser útil igualmente. Nos puede ayudar a superar el síndrome de la página en blanco, resumir un texto, extraer las palabras clave, reestructurarlo o bien corregirnos el estilo. Observad que en todos estos ámbitos no le cedemos el control a ciegas ya que podemos comprobar fácilmente el resultado. Si le pregunto qué pasó en Tunguska el 30 de junio de 1908 tendré que fiarme de lo que me diga.

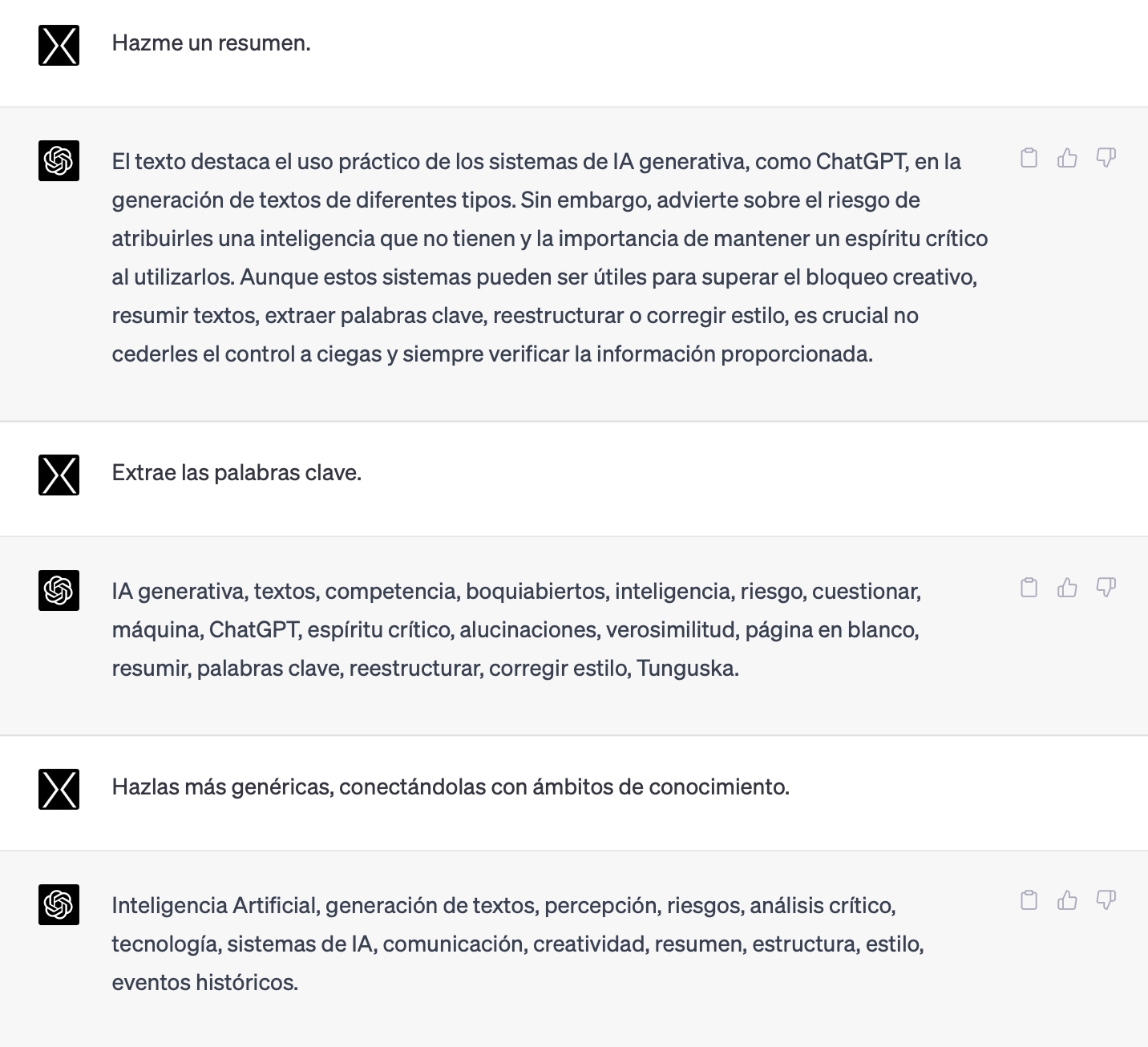

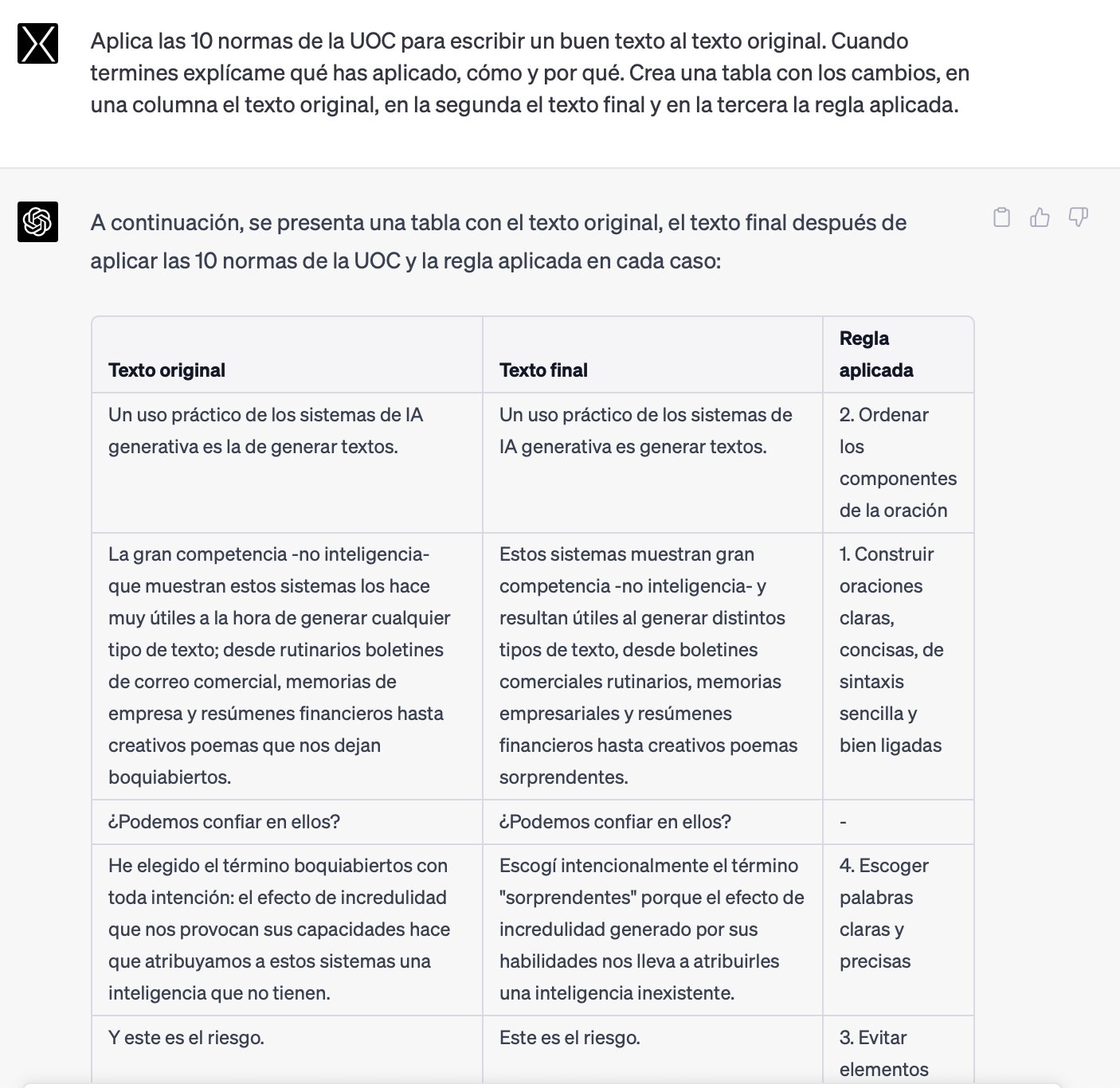

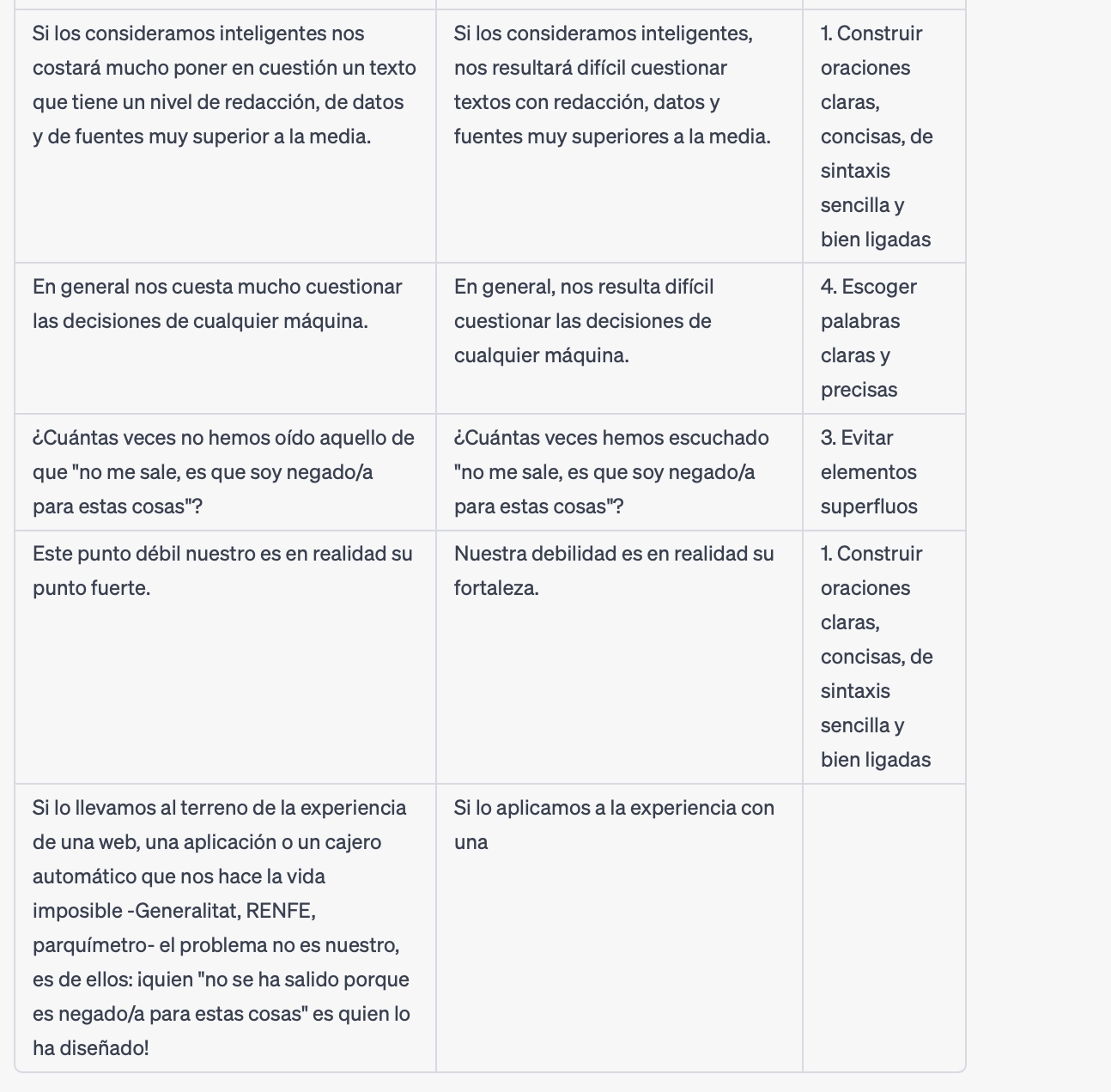

Dicho esto os dejo una prueba práctica de aplicación. He tomado el texto de este artículo y le he pedido que me lo resuma, me extraiga las palabras clave y que me corrija el estilo. El resultado a continuación:

Ahora, si queréis, podéis volver a leerlo con las correcciones de estilo que se han realizado con las 10 recomendaciones para redactar con eficacia de la UOC:

«Una aplicación práctica de los sistemas de IA generativa es generar textos. Estos sistemas son muy útiles para generar textos de cualquier tipo, gracias a su gran competencia, no inteligencia. Desde boletines de correo comercial, memorias de empresa y resúmenes financieros hasta poemas creativos que nos impresionan. ¿Podemos confiar en ellos?

He elegido el término «impresionado» intencionalmente: el efecto de incredulidad que nos provocan sus capacidades hace que atribuyamos a estos sistemas una inteligencia que no tienen. Y este es el riesgo. Si los consideramos inteligentes, nos costará mucho cuestionar un texto que tiene un nivel de redacción, de datos y de fuentes muy superior a la media.

En general, nos resulta difícil cuestionar las decisiones de las máquinas. ¿Cuántas veces hemos oído «no me salgo, es que soy negado/a para estas cosas»? Este nuestro punto débil es en realidad el suyo. Si lo llevamos al terreno de la experiencia de una web, una aplicación o un cajero automático que nos hace la vida imposible -Generalitat, RENFE, máquina del parking- el problema no es nuestro, es de ellos: ¡quien «no se sale porque es negado/a para estas cosas» es quien lo ha diseñado!

Si ya mostramos sumisión ante máquinas sin inteligencia, ¡imagínense ante un ChatGPT que creemos inteligente y omnisciente! Es por eso que cuando nos enfrentamos con uno de estos sistemas debemos tener el espíritu crítico más a punto que nunca. Son conocidas las «alucinaciones» (sí, ese es el término técnico) que tiene el ChatGPT; cuando no sabe algo se lo inventa. Su tono de seguridad, la verosimilitud del texto y el hecho de que nos lo diga una máquina nos hará muy difícil detectarlo.

A pesar de todo, puede sernos útil. Nos puede ayudar a superar el síndrome del folio en blanco, resumir un texto, extraer las palabras clave, reestructurarlo o corregirlo en el estilo. Nótese que en estos ámbitos no le damos el control total, ya que podemos comprobar fácilmente los resultados. Si le pregunto qué pasó en Tunguska el 30 de junio de 1908 me tendré que fiar de lo que me diga.”.