Una utilització pràctica dels sistemes d’IA generativa és la de generar textos. La gran competència —no intel·ligència— que mostren aquests sistemes els fa molt útils a l’hora de generar qualsevol tipus de text; des de rutinaris butlletins de correu comercial, memòries d’empresa i resums financers fins a creatius poemes que ens deixen bocabadats. Ens hem podem refiar?

He triat el terme bocabadat amb tota la intenció: l’efecte d’incredulitat que ens provoquen les seves capacitats fa que atribuïm a aquests sistemes una intel·ligència que no tenen. I aquest és el risc. Si els considerem intel·ligents ens costarà molt posar en qüestió un text que té un nivell de redacció, de dades i de fonts molt superior a la mitjana.

En general ens costa molt qüestionar les decisions de qualsevol màquina. Quantes vegades no hem sentit allò de que “no me’n surto, és que sóc negat/da per aquestes coses”. Aquest nostre punt feble és en realitat el seu. Si ho portem al terreny de l’experiència d’un web, una aplicació o un caixer automàtic que ens fa la vida impossible -Generalitat, RENFE, màquina del pàrquing- el problema no és nostre, és d’ells: qui “no se n’ha sortit perquè és negat/da per aquestes coses” és qui l’ha dissenyat!

Si ja mostrem aquesta submissió davant d’una màquina sense cap mena d’intel·ligència imagineu-vos davant un ChatGPT a qui creiem intel·ligent i omniscient! És per això que quan ens enfrontem amb un d’aquests sistemes hem de tenir l’esperit crític més a punt que mai. Són conegudes les “al·lucinacions” (sí aquest és el terme tècnic) que té el ChatGPT; quan no sap alguna cosa se l’inventa.

El seu to de seguretat, la versemblança del text i el fet que ens ho digui una màquina ens farà molt difícil de detectar-ho.

Però ens pot ser útil nogensmenys. Ens pot ajudar a superar la síndrome del full en blanc, resumir un text, extraure’n les paraules clau, reestructurar-nos-el o bé corregir-nos-en l’estil. Observeu que en tots aquests àmbits no li cedim el control a cegues ja que en podem comprovar fàcilment el resultat. Si li pregunto què va passar a Tunguska el 30 de juny de 1908 m’hauré de refiar del que em digui.

Dit això, us deixo una prova pràctica d’aplicació. He agafat el text d’aquest article i li he demanat que me’l resumeixi, me n’extregui les paraules clau i que me’n corregeixi l’estil. El resultat a continuació:

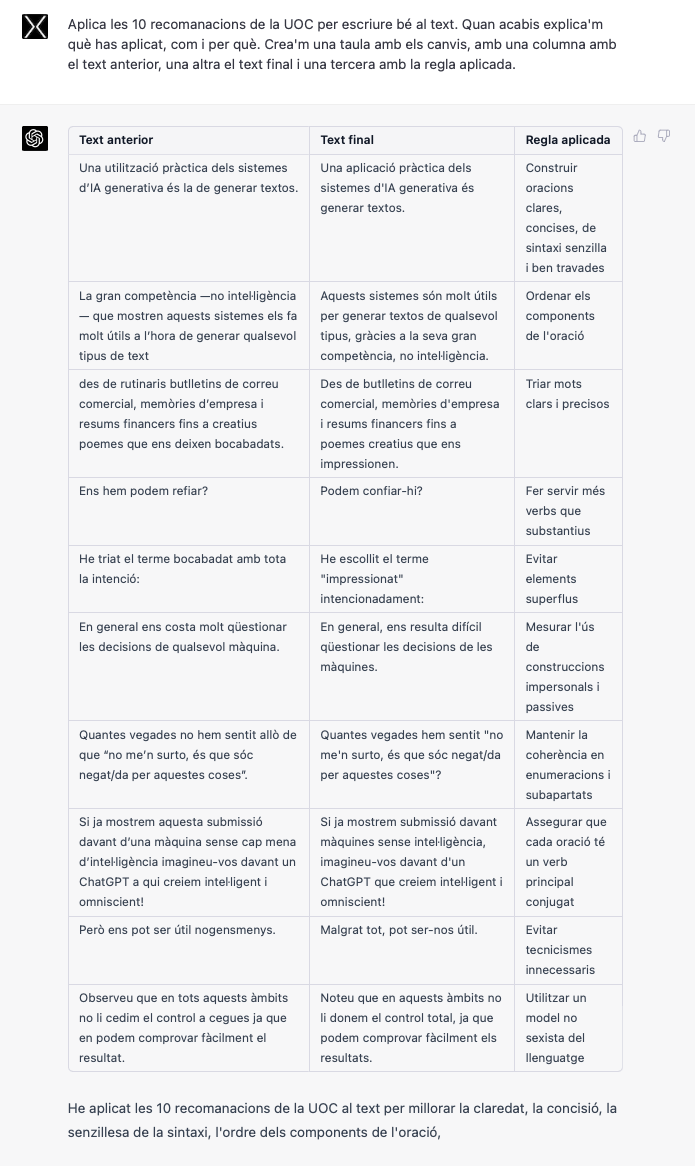

Ara, si ho voleu, el podeu tornar a llegir amb les correccions d’estil que hi ha fet amb les 10 recomanacions per redactar amb eficàcia de la UOC:

“Una aplicació pràctica dels sistemes d’IA generativa és generar textos. Aquests sistemes són molt útils per generar textos de qualsevol tipus, gràcies a la seva gran competència, no intel·ligència. Des de butlletins de correu comercial, memòries d’empresa i resums financers fins a poemes creatius que ens impressionen. Podem confiar-hi?

He escollit el terme “impressionat” intencionadament: l’efecte d’incredulitat que ens provoquen les seves capacitats fa que atribuïm a aquests sistemes una intel·ligència que no tenen. I aquest és el risc. Si els considerem intel·ligents ens costarà molt posar en qüestió un text que té un nivell de redacció, de dades i de fonts molt superior a la mitjana.

En general, ens resulta difícil qüestionar les decisions de les màquines. Quantes vegades hem sentit “no me’n surto, és que sóc negat/da per aquestes coses”? Aquest nostre punt feble és en realitat el seu. Si ho portem al terreny de l’experiència d’un web, una aplicació o un caixer automàtic que ens fa la vida impossible -Generalitat, RENFE, màquina del pàrquing- el problema no és nostre, és d’ells: qui “no se n’ha sortit perquè és negat/da per aquestes coses” és qui l’ha dissenyat!

Si ja mostrem submissió davant màquines sense intel·ligència, imagineu-vos davant d’un ChatGPT que creiem intel·ligent i omniscient! És per això que quan ens enfrontem amb un d’aquests sistemes hem de tenir l’esperit crític més a punt que mai. Són conegudes les “al·lucinacions” (sí aquest és el terme tècnic) que té el ChatGPT; quan no sap alguna cosa se l’inventa. El seu to de seguretat, la versemblança del text i el fet que ens ho digui una màquina ens farà molt difícil de detectar-ho.

Malgrat tot, pot ser-nos útil. Ens pot ajudar a superar la síndrome del full en blanc, resumir un text, extraure’n les paraules clau, reestructurar-nos-el o bé corregir-nos-en l’estil. Noteu que en aquests àmbits no li donem el control total, ja que podem comprovar fàcilment els resultats. Si li pregunto què va passar a Tunguska el 30 de juny de 1908 m’hauré de refiar del que em digui.”.